/* Css En-Bref */

.en-bref {

max-width: 640px;

margin: 2em auto;

padding: 1.5em 1.8em;

background: #f7f9f9;

border: 1px solid #10b58b;

border-left: 6px solid #10b58b;

border-radius: 12px;

box-shadow: 0 8px 24px rgba(251, 191, 36, 0.15);

font-family: ‘Inter’, ‘Segoe UI’, sans-serif;

color: #3a2d0d;

text-align: left;

}

.en-bref .enbref-header {

font-size: 1.15em;

font-weight: 700;

color: #d97706;

margin-bottom: 0.6em;

display: flex;

align-items: center;

gap: 0.5em;

}

.en-bref p {

font-size: 1em;

line-height: 1.65;

margin: 10px;

}

.en-bref strong {

color: #1c1917;

}

| Puntos clave | Detalles a recordar |

|---|---|

| 🔍 Definición actual | El machine learning en 2025 se basa en sistemas capaces de auto-optimización y aprendizaje continuo sin intervenciones humanas constantes |

| 🚀 Evoluciones mayores | Modelos multimodales combinando texto, imagen y sonido + aprendizaje federado como estándar industrial |

| 🌐 Infraestructura | Dominio de las arquitecturas neuromórficas y cómputo cuántico híbrido para el entrenamiento de modelos |

| ⚙️ Despliegue | Edge computing masivo con modelos ligeros auto-compilados para dispositivos IoT |

| 📊 Datos | Generación sintética de datasets vía GANs avanzados + filtrado dinámico de sesgos |

| 🧠 Inteligencia adaptativa | Mecanismos de meta-aprendizaje que permiten el ajuste contextual en tiempo real |

El panorama del machine learning ha sufrido una mutación silenciosa pero radical desde el inicio de la década. Lo que antes parecía una colección de algoritmos estáticos se ha convertido en un ecosistema vivo, capaz de evolución orgánica. La ruptura radica menos en las proezas técnicas que en el cambio de filosofía: ya no se programa la inteligencia, se cultivan entornos donde ella emerge. La analogía hortícola no es fortuita: los data scientists de hoy se consideran más jardineros de la información que ingenieros.

Los nuevos fundamentos algorítmicos

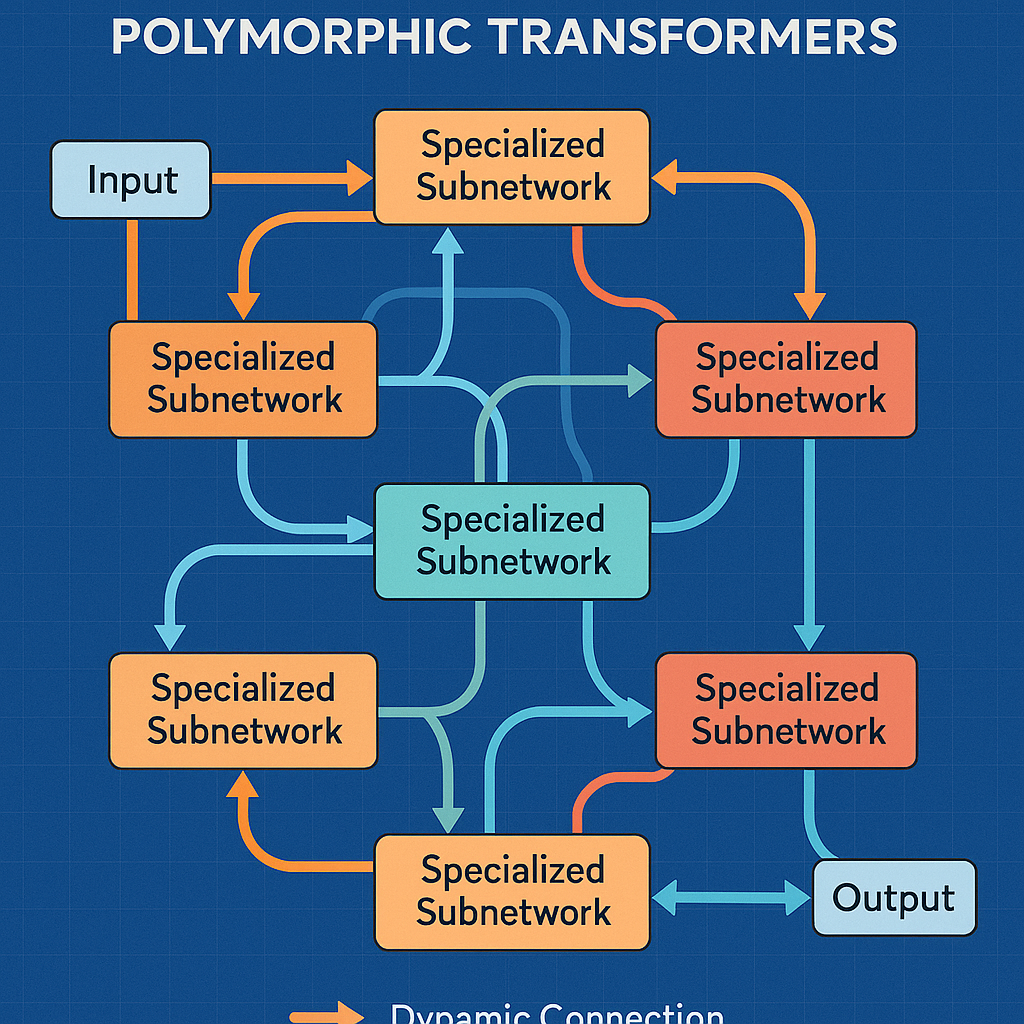

Las arquitecturas de deep learning han dado un salto cualitativo con la llegada de los transformers polimórficos. A diferencia de los modelos monolíticos de los años 2020, estos sistemas articulan dinámicamente subredes especializadas según el contexto. Imagine una orquesta donde cada músico domina varios instrumentos y adapta su partitura según la acústica del lugar: esa es la flexibilidad que ofrecen estas estructuras modulares.

El aprendizaje auto-supervisado contextual

El preentrenamiento masivo sobre corpus generalistas ha cedido lugar a mecanismos de auto-correlación contextual. En lugar de ingerir petabytes de datos en bruto, los modelos contemporáneos identifican por sí mismos las lagunas en sus conocimientos y generan consultas específicas para llenarlas. Un estudio reciente del MIT (2024) demuestra que este enfoque reduce en un 80% la necesidad de datos externos para tareas especializadas como el diagnóstico médico.

El papel de las meta-redes reguladoras

Estos controladores neuronales supervisan permanentemente los sesgos de ejecución y las desviaciones conceptuales. Cuando su asistente de voz adapta repentinamente su nivel de lenguaje a su estado de ánimo detectado, es obra de estos guardianes inteligentes. Operan como un sistema inmunológico cognitivo, aislando razonamientos falaces antes de que contaminen las decisiones.

Infraestructura: la revolución material invisible

Sin bombo ni platillo, el ecosistema material ha experimentado transformaciones profundas. Las TPU (Tensor Processing Units) de cuarta generación integran ahora módulos dedicados al cálculo diferencial privado, permitiendo procesar datos sensibles sin jamás descifrarlos. El cifrado homomórfico ya no es una curiosidad académica sino un componente estándar de los chips neuromórficos.

El advenimiento de la computación cuántica utilitaria

A diferencia de las predicciones eufóricas, la computadora cuántica universal sigue fuera de alcance. Pero los procesadores híbridos cuántico-clásicos han encontrado su nicho en la optimización de hiperparámetros. Empresas como QuML Tech ofrecen servicios en la nube donde su modelo clásico delega los cálculos de espacios latentes complejos a coprocesadores cuánticos, reduciendo así el tiempo de entrenamiento de días a horas para ciertas arquitecturas.

La computación en el borde madura

Las restricciones energéticas han impulsado la innovación. Los últimos smartphones incorporan aceleradores de ML capaces de ejecutar modelos de 500 millones de parámetros con un consumo inferior a 3 vatios. ¿El secreto? Técnicas de compilación adaptativa como el cómputo disperso que desactivan dinámicamente hasta el 70% de las neuronas sin pérdida de precisión en tareas específicas.

El ciclo de vida de los modelos en 2025

El concepto de «modelo entrenado» pertenece al pasado. Llega el tiempo de sistemas en aprendizaje perpetuo, alimentados por flujos de datos dinámicos. Este cambio paradigmático viene acompañado de desafíos inéditos en materia de trazabilidad.

Validación continua

Las tradicionales fases de prueba son reemplazadas por bucles de retroalimentación en tiempo real. En aplicaciones críticas como la conducción autónoma, cada decisión es evaluada por un gemelo digital que simula miles de escenarios paralelos. Si surge un sesgo, se corrige antes de la siguiente iteración — un proceso que los ingenieros llaman «inmunidad adaptativa».

«Ya no certificamos modelos fijos, sino procesos de aprendizaje» – Dra. Lena Kovac, presidenta de la Alianza por la IA Ética

Gobernanza mediante blockchain cognitiva

Cada modificación de los pesos de un modelo se registra en registros distribuidos, creando un árbol genealógico verificable. Esta trazabilidad se volvió crucial desde el reglamento europeo IA-2024 que impone una explicabilidad retrospectiva de las decisiones automatizadas. En la práctica, esto permite rastrear el origen de un comportamiento aberrante como se seguiría una pista de ADN.

Las aplicaciones transformadoras

La verdadera revolución no reside en los laboratorios de investigación sino en la industrialización masiva. Tres sectores encarnan esta mutación:

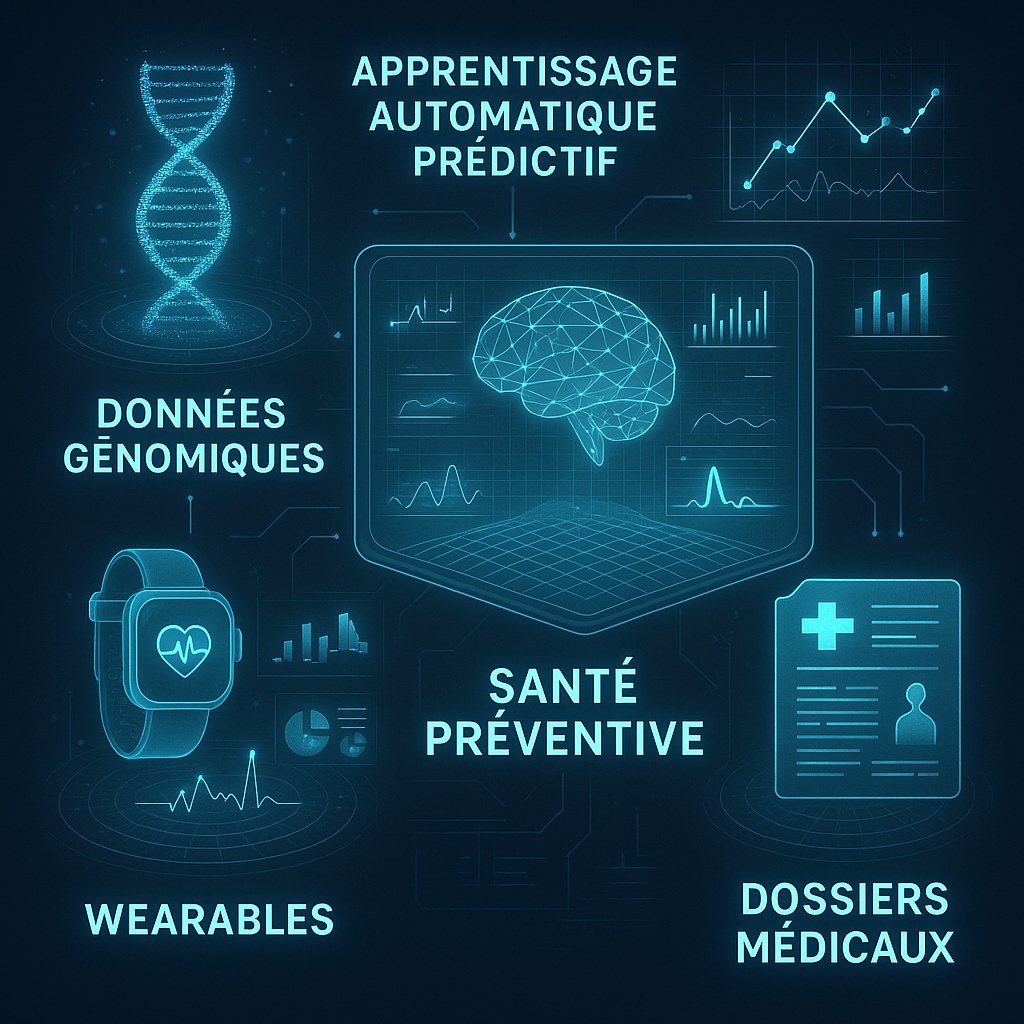

- Salud preventiva: Los algoritmos cruzan ahora datos genómicos con hábitos de vida captados por dispositivos wearables para predecir patologías 5 años antes de su aparición clínica. La clínica Mayo reporta una reducción del 40% en hospitalizaciones de emergencia gracias a estos sistemas.

- Agricultura cognitiva: Drones equipados con sensores hiperespectrales analizan el estado micronutricional de los cultivos, mientras modelos predictivos optimizan el riego y los tratamientos a escala de cada planta.

- Industria regenerativa: Las fábricas «cero residuos» usan ML para maximizar el reciclaje de materiales en tiempo real. Empresas como CircularTech alcanzan tasas de reutilización del 99,2% en sus cadenas de producción.

Los desafíos persistentes

A pesar de los avances, algunos problemas persisten. La equidad algorítmica sigue siendo un reto abierto — filtrar sesgos estadísticos es sencillo, pero corregir distorsiones sistémicas exige una reestructuración de los procesos de anotación. Iniciativas como DAIR (Distributed AI Research) trabajan en protocolos de etiquetado descentralizados donde cada contribuyente valida las anotaciones de los demás mediante mecanismos de consenso.

La sobriedad energética

El entrenamiento de un mega-módulo siempre consume el equivalente energético de una pequeña ciudad. ¿Vendrá la solución de los materiales superconductores a temperatura ambiente? ¿O de algoritmos radicalmente más eficientes como la Red Neuronal Líquida del MIT, cuyas conexiones dinámicas reducen el consumo en un 95%? La carrera ha comenzado.

La seguridad cognitiva

Los ataques por perturbación adversaria han ganado en sofisticación. Investigadores de Stanford han demostrado que es posible «hipnotizar» un modelo de visión por computadora con patrones luminosos específicos, volviéndolo temporalmente ciego a ciertos objetos. La defensa consiste en capas de detección de anomalías conductuales integradas directamente en las redes neuronales.

FAQ: El aprendizaje automático en 2025

¿Cuál es la principal diferencia con el ML de los años 2020?

El fin del paradigma «entrenar y luego desplegar». Los modelos actuales aprenden de manera continua a partir de datos operativos, con mecanismos estrictos de autocontrol.

¿Pueden las pequeñas empresas usar estas tecnologías?

Absolutamente. Plataformas como ML-As-A-Service 2.0 ofrecen capacidades de vanguardia mediante suscripciones modulares, eliminando la necesidad de infraestructuras pesadas.

¿Está garantizada la explicabilidad?

No sistemáticamente, pero las herramientas de XAI (Inteligencia Artificial Explicable) ahora generan informes comprensibles para no expertos, satisfaciendo así los requisitos regulatorios.

¿Ha cumplido el quantum sus promesas?

Parcialmente. Sobresale en la optimización combinatoria pero sigue siendo marginal para tareas de percepción como la visión por computadora. Su adopción es gradual.

¿Cuál es la habilidad más buscada?

La ingeniería de prompts para modelos multimodales, combinando dominio técnico y creatividad semántica, una profesión que no existía hace tres años.